빠르게 진화하는 인공지능(AI)의 잠재적 위험을 경고하고 이에 관한 각국의 협력을 촉구하는 국제사회 차원의 목소리가 처음 나왔다.

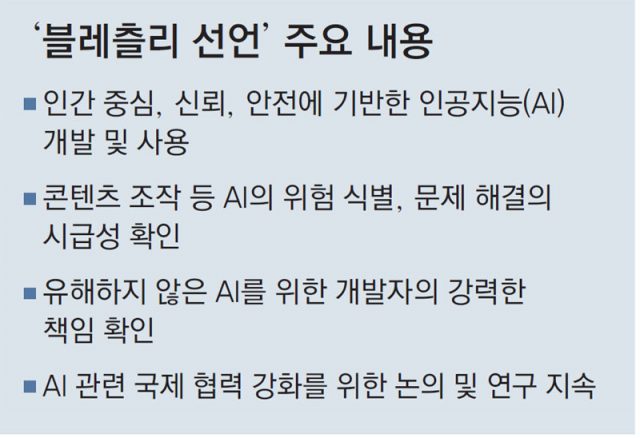

미국, 중국, 한국 등 28개국과 유럽연합(EU)은 1일(현지시간) 영국에서 개막한 ‘제1차 AI 안전 정상회의’에서 고도의 능력을 갖춘 프런티어 AI가 파국적 피해를 초래할 수도 있다면서 위험 대처에 관한 이해를 넓히는 한편 국가 간 협력이 필요하다는 내용의 ‘블레츨리 선언’을 채택했다.

이 행사에는 개최국인 영국의 리시 수낵 총리를 비롯해 커밀라 해리스 미국 부통령, 우르줄라 폰데어라이엔 EU 집행위원장, 안토니우 구테흐스 유엔 사무총장 등이 참석했고 일론 머스크 테슬라 최고경영자(CEO), 브래드 스미스 마이크로소프트(MS) 부회장, 챗GPT 개발사인 오픈AI의 샘 올트먼 CEO 등 관련 기업인들도 초청됐다.

윤석열 대통령은 이 회의에서 화상 연설을 통해 디지털 국제 규범 정립을 위한 연대와 관련 국제기구의 설립을 역설할 계획이다. 한국은 또 이번 회의와 1년 뒤 프랑스 파리에서 열리는 2차 정상회의 중간인 내년 5월 영국과 함께 AI의 안전한 활용을 위한 ‘미니 정상회의’를 공동 개최할 예정이다.

AI의 발전이 인류에게 위협이 되지 않는 방식으로 진행돼야 한다는 국제사회의 공감대가 확산하면서 향후 관련 규제가 어떤 모습으로 구체화할지 주목된다.

최근 AI 기술의 발전 속도는 놀라울 정도다. 이미 여러 분야에서 인간의 한계를 뛰어넘었고, 그 범위는 갈수록 넓어지고 있다. AI가 인류의 삶을 획기적으로 개선할 것이라는 기대와 불확실한 미래에 대한 두려움이 함께 교차하는 이유다.

기계가 사람을 지배하는 공상과학 영화 속 디스토피아까지는 아직 아니지만 그런 가능성을 슬쩍슬쩍 내비치는 징후는 벌써 곳곳에서 나타나고 있다.

지난 5월에는 미국 국방부 청사(펜타곤) 근처에서 대형 폭발이 일어났다는 글과 사진이 인터넷상에 떠돌면서 금융시장이 출렁이는 일이 있었으나 실제로는 AI를 이용한 가짜뉴스로 판명됐다. AI가 보이스피싱 등 범죄에 악용되고 있다는 보고도 잇따르고 있다. 생성형 AI가 만들어낸 사진, 동영상, 목소리는 진짜인지 아닌지 구별할 수 없을 만큼 정교해졌다.

AI의 발전이 자칫 인류에게 악몽이 될지 모른다는 우려가 커지면서 AI 선구자들까지 규제의 필요성을 호소하고 있다. ‘딥러닝의 대부’로 불리는 제프리 힌턴 박사는 AI 연구의 위험성을 경고하기 위해 10년간 몸담았던 구글에 사표를 냈고, 챗GPT의 창시자인 샘 올트먼 오픈AI CEO는 정부의 규제와 국제적 감시 기구의 설립을 촉구했다.

무한한 잠재력을 가진 AI는 잘만 활용하면 당연히 인류에 큰 보탬이 되겠지만 그 전제는 적절한 관리와 통제다. 단순한 사기 범죄나 허위 정보의 수준을 넘어 국가 안보와 공공의 안녕, 그리고 인간의 생명까지 위협하는 AI의 역습이 본격화할 경우 그 고삐를 잡기가 더욱 어려워지는 만큼 너무 늦지 않게 규제를 시작해야 한다.

AI는 양날의 칼이라고 한다. 따라서 기본 원칙은 이익이 되는 날은 더욱 세련되게 벼리고, 반대 날에는 확실한 안전장치를 두르는 것이다. 이틀 전 미국의 조 바이든 대통령은 AI 기술의 오남용에 따른 위험을 막기 위한 행정명령에 서명했다.

우리 정부 역시 지난 9월 가짜 뉴스 확산 방지에 대한 기본 원칙을 제시한 ‘디지털 권리장전’을 발표했으나 준비와 대응이 아직은 초보 단계다. 국제사회와 협력해 규제 표준 제정에 적극적으로 참여하고, 국회에 계류 중인 ‘인공지능기본법안’도 서둘러 처리하길 바란다. 동시에 AI 기술·산업을 발전시키기 위한 노력도 게을리하지 말아야 한다.

AI와 같은 첨단 분야는 승자 독식의 특성이 뚜렷해 외국 기업이 국내 AI 시장을 선점할 경우 반전이 쉽지 않고, 규제의 효과도 떨어질 공산이 크다. 정부·국회는 진흥과 규제라는 수레의 두 바퀴가 조화를 이뤄 힘차게 나아갈 수 있도록 관련 제도와 법률을 신속하게 정비하길 당부한다. [연합시론]

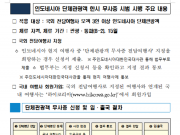

![[사설] 인도네시아 단체관광객 무사증 시대, 준비는 됐나](https://haninpost.com/wp-content/uploads/2025/07/‘2025-Jakarta-K-Food-Fair-현장을-방문한-인도네시아-한류팬.-2025.7.11.-사진-aT센터-180x135.jpg)

![[전략 자원 수출 국영기업 단일화 정부령 시행 전망]](https://haninpost.com/wp-content/uploads/2026/05/프라보워-수비안토-대통령은-야자유팜유에서-석탄에-이르는-일부-전략적-천연자원-원자재의-수출을-지정된-국영기업BUMN을-180x135.jpg)

![[그래픽] 트럼프·시진핑 베이징 정상회담, 협력확대 한목소리 냈으나 ‘대타협’ 없어](https://haninpost.com/wp-content/uploads/2026/05/트럼프·시진핑-2026-베이징-미중-정상회담-180x135.jpg)

![[기획 연재8] 인도네시아 할랄 인증, ‘비용·시간·리스크’ 3중고 넘어야 시장 열린다](https://haninpost.com/wp-content/uploads/2026/04/박단열-대표-238x178.png)

![[기획 연재7] 인도네시아 할랄 인증의 분수령, 승패는 ‘현장’에서 갈린다](https://haninpost.com/wp-content/uploads/2026/02/박단열-대표-238x178.png)

카톡아이디 haninpost

카톡아이디 haninpost

![[단독] DKI 자카르타 태권도 협회, 한국 국기원 사범 초청 ‘품새 코칭 클리닉’ 성황리 개최… 지도력 경쟁력 강화 박차](https://haninpost.com/wp-content/uploads/2026/06/DKI-자카르타-태권도-협회가-주최한-‘품새-코칭-클리닉Coaching-Clinics-Poomsae에서-한국에서-초청된-박동훈-사범공인-7단이-지도하고-있다.-2025.5.25.-사진-한인포스트-100x75.jpg)